Kecerdasan Buatan (AI) Tak Bisa Dipercaya Sepenuhnya, Butuh Evaluasi Kritis

Wamenristekdikti ingatkan AI tidak sepenuhnya bisa dipercaya, contohnya dalam prediksi kualifikasi Piala Dunia. Penggunaan AI perlu pemikiran kritis dan evaluasi. Kasus Meta dan BuzzFeed tunjukkan risiko *hype*. GenAI di pengadilan perlu kehati-hatian karena potensi kesalahan. Pengawasan manusia dan tujuan jelas kunci sukses jangka panjang AI.

Berita Terbaru

Prediksi Jensen Huang: Tenaga Kerja Masa Depan Gabungkan Manusia dan AI

DPR Desak Kemenpora Diplomasi IOC: Bela Palestina, Jaga Kehormatan Olahraga

Kejagung Ungkap: Sandra Dewi Terima Rp3,15 M dari Helena Lim, Disamarkan Utang

Maduro Mohon 'No Crazy War': AS Kirim Kapal Perang ke Karibia

Agensi Park Bom Tepis Kabar Gugatan ke YG, Pastikan Gaji Sudah Lunas

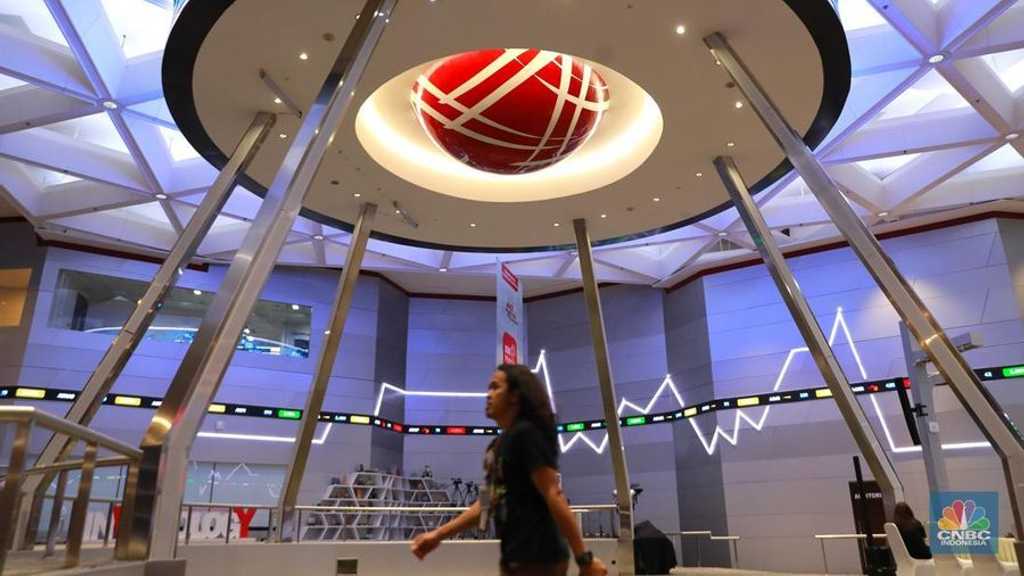

IHSG Melesat, Cetak Rekor Baru di Level 8.351

Komdigi: 1.674 Hoaks Teridentifikasi di Ruang Digital dalam Setahun

Erick Thohir Tak Gentar Larangan IOC, Bela Pembatalan Visa Atlet Israel

Gaji ASN 2026: Menkeu Purbaya Belum Dengar Detail dari Presiden

Konflik Perbatasan Thailand-Kamboja: Gencatan Senjata Segera, Trump Turut Saksikan